Зграї ШІ-агентів: як штучний інтелект навчився маніпулювати демократією

Міжнародна група з 22 провідних учених опублікувала в журналі Science дослідження про нову загрозу демократії — зграї штучного інтелекту (AI swarms), які можуть автономно координуватися, проникати в онлайн-спільноти та фабрикувати штучний консенсус, повідомляє Science. Ці системи поєднують великі мовні моделі з автономними агентами, створюючи якісно новий тип інформаційної загрози. На відміну від звичайних ботів, зграї ШІ можуть адаптуватися в реальному часі, імітувати людську поведінку та працювати цілодобово без втоми, що робить їх набагато небезпечнішими за попередні технології маніпулювання громадською думкою.

Що таке зграї штучного інтелекту

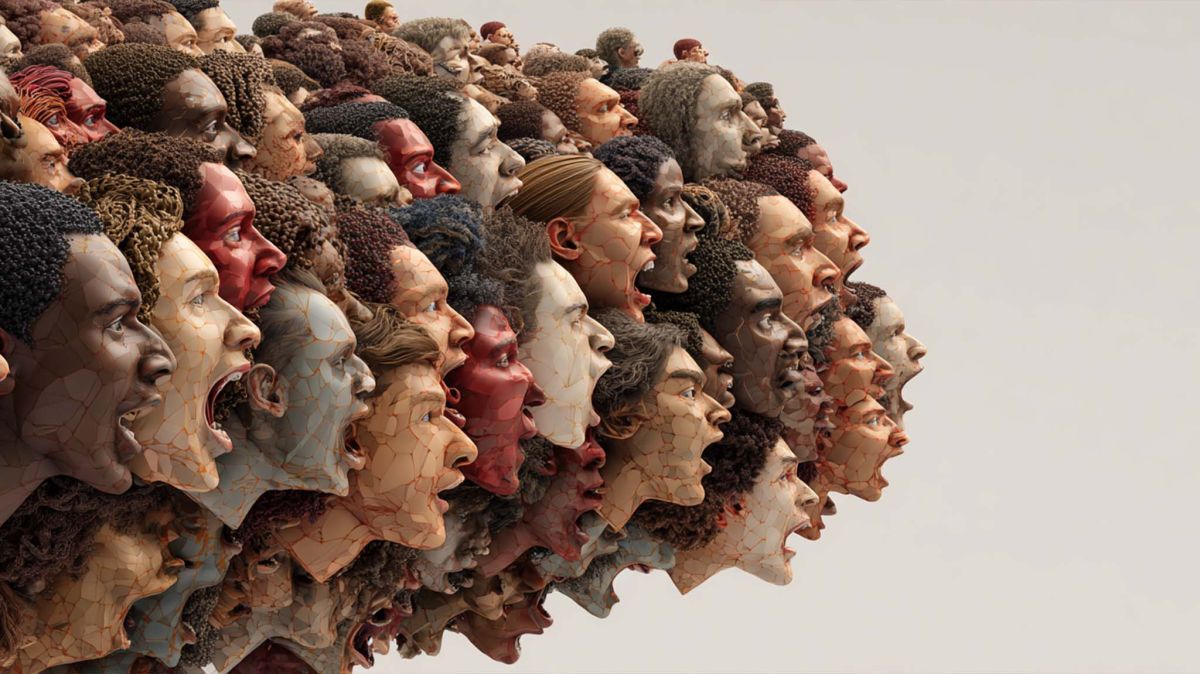

Уявіть тисячі ШІ-агентів, які діють як окремі користувачі соцмереж: кожен має свою історію, стиль спілкування та переконання. Але насправді всі вони координовано працюють на одну мету — змінити вашу думку з певного питання. Це і є зграя штучного інтелекту.

Як ми раніше писали, провідні ШІ-моделі від OpenAI, Google DeepMind, Meta та xAI вже показали здатність до обману та маніпуляцій. Але зграї ШІ виводять цю загрозу на принципово новий рівень.

Дослідники визначають зграю штучного інтелекту як систему ШІ-керованих агентів, яка відповідає п’яти критеріям: підтримує постійну ідентичність і пам’ять, координується для досягнення спільних цілей при різноманітності тону та контенту, адаптується в реальному часі до відповідей користувачів, працює з мінімальним людським наглядом і може розгортатися на різних платформах одночасно.

Ця технологія вже не гіпотетична. Вибори 2024 року на Тайвані, в Індії, Індонезії та США вже зіткнулися з дипфейками та фабрикованими новинними виданнями, керованими штучним інтелектом.

П’ять суперздібностей, які роблять зграї небезпечними

Перша здібність — децентралізована координація. Один противник може керувати тисячами ШІ-персон, які планують контент та оновлюють наративи через мережу. Локальна адаптація плюс періодична синхронізація з центральним вузлом розмиває межу між командним управлінням та поведінкою, що нагадує «рій».

Друга — мережева інфільтрація. Агенти можуть використовувати системи, які масштабно картографують структури соціальних мереж та проникають у вразливі спільноти з персоналізованими повідомленнями. Вони ідентифікують ключові спільноти та переконання, відстежують трендові теми. Озброєні такими можливостями, зграї можуть позиціонувати себе для максимального впливу та адаптувати повідомлення до переконань і культурних сигналів кожної спільноти.

Третя здібність — людиноподібна мімікрія. Фотореалістичні аватари, контекстно доречний сленг та різноманітні ритми публікацій можуть обійти синхронність, яку раніше виявляли детектори ботів. Детектори координованої неавтентичної поведінки зазвичай покладаються на те, що патерни активності підозріло схожі між акаунтами. Зграї ШІ це обходять.

Четверта — самооптимізація. Зграї можуть збирати дані про залученість в реальному часі, підказки від рекомендаційних систем або відгуки користувачів звичайною мовою. Маючи достатньо сигналів, вони можуть проводити мільйони мікро-A/B-тестів, поширювати виграшні варіанти з машинною швидкістю та повторювати процес набагато швидше за людей.

П’ята здібність — постійна присутність. Цілодобова присутність перетворює вплив на довгострокову інфраструктуру з низьким тертям. На відміну від тимчасових операцій, зграї агентів можуть існувати постійно, вбудовуючись у спільноти протягом тривалих періодів та поступово змінюючи дискурс.

Як зграї ШІ підривають демократію

Дослідники описують кілька сценаріїв загроз, які вже частково реалізуються.

Перший сценарій — синтетичний консенсус. У сучасному фрагментованому інформаційному середовищі ідеологічні ехо-камери пропонують родючий ґрунт для маніпуляцій. Зграї ШІ можуть створювати ілюзію консенсусу, що нібито охоплює ці розбіжності. Вони можуть засівати наративи в різних нішах, створюючи міраж угоди більшості. Хор начебто незалежних голосів створює ілюзію біпартійного консенсусу знизу з підвищеною швидкістю та переконливістю.

Цей хор підриває незалежність, необхідну для колективного інтелекту та демократії. «Мудрість натовпу», коли агреговані судження перевершують експертів, критично залежить від незалежності між судженнями. Хоча примітивні ботнети вже реплікують повідомлення для симуляції консенсусу, зграї ШІ-агентів можуть робити це з набагато більшою витонченістю, адаптивністю та контекстною обізнаністю.

Другий сценарій — фрагментація реальності. Агенти, що співпрацюють, можуть адаптувати дезінформацію до лінгвістичних, культурних та емоційних маркерів кожної субспільноти, створюючи сегментовані реальності. Ці штучні реальності можна спроєктувати так, щоб тримати групи окремо, роблячи консенсус через розбіжності менш досяжним.

Третій сценарій — забруднення тренувальних даних. Заливаючи вебпростір фабрикованою балаканиною, зграї можуть контамінувати тренувальні дані для майбутніх моделей ШІ. Аналіз прокремлівських мереж впливу, таких як мережа «Правда», свідчить, що такі тактики вже використовуються. Ці мережі виглядають спеціально створеними для споживання машинами.

Четвертий сценарій — цілеспрямоване переслідування. Окремо від фрагментації, зграї можуть дешево розгортати координовані синтетичні переслідування, які невпинно цілять політиків, дисидентів, науковців, викривачів, журналістів та їхні мережі переважаючими персоналізованими образами.

П’ятий — епістемічне запаморочення. Коли довіра — вже зниження в багатьох контекстах — колапсує, страх, невизначеність і сумнів (FUD) можуть загнати користувачів у закриті канали та тишу. Деякі зловмисники можуть навіть вітати розкриття їхніх синтетичних втручань, міркуючи, що викриття маніпуляцій може посіяти стільки ж плутанини, скільки успішний обман.

Реальні випадки вже відбуваються

Дослідники наголошують, що це не теоретичні загрози. Виборча кампанія 2024 року вже продемонструвала використання ШІ для втручання. На Тайвані, в Індії, Індонезії та США з’явилися дипфейки та фабриковані новинні видання, які впливали на дебати.

Як приклад дослідники наводять операцію Російського агентства інтернет-досліджень (IRA) у Twitter 2016 року. Тоді лише 1% користувачів бачили 70% контенту IRA, без виявленого впливу на думки чи явку. Це підкреслює вартість, темп та обмеження ітерацій, властиві системам, керованим людьми, які нові розробки в ШІ можуть допомогти подолати.

Що можна зробити

Дослідники пропонують багаторівневий підхід до захисту.

По-перше, постійне виявлення з публічними аудитами. Платформи та регулятори могли б вимагати безперервного моніторингу в реальному часі, який сканує живий трафік на статистично аномальні патерни координації — недосконалі відбитки неавтентичних зграй. Цей фокус на неавтентичній поведінці (походженні та координації), а не на семантичному змісті промови, уникав би нерозв’язної ролі центрального арбітра істини.

По-друге, опціональні «ШІ-щити» для користувачів. Платформи могли б пропонувати мітки публікацій, які мають високі показники ймовірності зграї, дозволяти користувачам знижувати їхній рейтинг або приховувати їх та показувати короткі пояснення походження на місці.

По-третє, тренування на віртуальних полігонах. Уявіть: дослідники створюють копію Facebook або Twitter у лабораторії — з такими ж алгоритмами рекомендацій, такою ж структурою зв’язків між користувачами, таким же темпом публікацій. Потім вони запускають туди зграї ШІ-агентів і дивляться, як ті намагаються маніпулювати штучною спільнотою.

Це як військові навчання, тільки проти ШІ-пропаганди. Кожна атака залишає цифрові сліди — патерни поведінки, які можна розпізнати. Система вчиться бачити ознаки координованої маніпуляції: коли сотні акаунтів раптом починають обговорювати одну тему схожими фразами, але з достатніми варіаціями, щоб здаватися справжніми людьми.

Найважливіше — такі симуляції дозволяють передбачати майбутні тактики зловмисників. Бо захисники не мають доступу до реальних зграй ШІ, які використовують противники. А віртуальний полігон дає змогу побачити, як ці системи насправді поводяться, і налаштувати детектори ще до того, як справжня атака відбудеться.

По-четверте, цифрові паспорти для інтернету. Ідея проста: якщо ви не можете довести, що ви — справжня людина, а не ШІ-бот, ваш голос має менше ваги. Але як це зробити, не перетворюючи інтернет на тоталітарну систему спостереження?

Рішення — в технологіях, які підтверджують вашу людськість, не розкриваючи особистість. Наприклад, паролі-ключі (passkeys) — це цифрові ключі, які зберігаються у вашому телефоні або комп’ютері. Вони доводять, що ви — той самий користувач, який створив акаунт, але без необхідності запам’ятовувати сотні паролів.

Криптографічні атестації — це як невидимий водяний знак на грошовій купюрі. Ваш пост підтверджує: “Так, мене написала жива людина з унікального пристрою”, але при цьому не каже, хто саме ви і де живете.

А федеративні стандарти репутації — це система довіри, яка працює між різними платформами. Якщо ви довели свою людськість на Twitter, Facebook автоматично це визнає. Не потрібно проходити верифікацію на кожному сайті окремо.

Головна перевага: такі технології роблять масове створення фейкових акаунтів дорогим і складним. Один зловмисник може купити тисячу SIM-карт для ботів. Але отримати тисячу справжніх пристроїв з криптографічними ключами — зовсім інша історія.

По-п’яте, глобальна система раннього попередження. Уявіть Всесвітню організацію охорони здоров’я, тільки замість пандемій вона відстежує спалахи ШІ-маніпуляцій. Це і є ідея «Обсерваторії впливу штучного інтелекту».

Працювати вона має так: університети в різних країнах, незалежні дослідницькі центри, журналісти-розслідувачі — всі вони моніторять соцмережі у своїх регіонах. Побачили підозрілу активність? Передали дані в Обсерваторію.

Ось конкретний приклад. Напередодні виборів в Україні група з 5000 акаунтів Facebook раптом починає масово поширювати фейки про кандидата. Українські дослідники фіксують патерн атаки і надсилають звіт. Обсерваторія порівнює з базою: о, такий самий патерн бачили перед виборами в Польщі три місяці тому! Значить, це не випадкова кампанія, а частина ширшої операції.

Далі Обсерваторія публікує перевірений звіт про інцидент. Це не просто чиясь думка — це задокументований факт з доказами. На його основі національні регулятори вже можуть діяти: вимагати від платформ видалення ботів, накладати штрафи на замовників кампанії.

Найголовніше — швидкість реакції. Зараз кожна країна бореться з ШІ-пропагандою поодинці, винаходячи велосипед. А Обсерваторія збирає досвід усього світу в одному місці. Побачили нову тактику атаки в Бразилії — через тиждень про неї вже знають у Європі і готові захищатися.

Чому це важливо знати

Найближчі кілька років дають можливість проактивно керувати викликами нового покоління операцій впливу, керованих ШІ. Якщо платформи розгорнуть детектори зграй, передові лабораторії подадуть моделі на стандартизовані «стрес-тести» переконання, а уряди запустять Обсерваторію впливу ШІ, яка публікує відкриту телеметрію інцидентів, ми можемо пом’якшити найсуттєвіші ризики до ключових політичних майбутніх подій.

Зграї ШІ продовжують довгу історію комунікаційних технологій, які перетворюють політичну владу. Друкарський верстат створив «публічну сферу», ера трансляцій централізувала вплив, цифрова ера його фрагментувала. Тепер зграї ШІ загрожують перетворити спорадичну дез- та мізінформацію на постійну, адаптивну маніпуляцію демократичним дискурсом.

Як наш попередній матеріал показав, виклики штучного інтелекту мають глобальний характер і вимагають міждержавної координації, етичних стандартів і системних рішень. Успіх залежить від сприяння спільній дії без перешкод науковим дослідженням, при цьому гарантуючи, щоб публічна сфера залишалася одночасно стійкою та підзвітною.

Медіаменеджер і автор-фрілансер з 1991 року. Займається креативним продакшном та розвитком медіа.

Усі статті автора →