ШІ-агенти вербують людей як датчики: що це означає і чим загрожує

Доцент Кембриджського університету Уманг Бхатт у матеріалі для Noema Magazine описує, як ШІ-агенти перестали просити людей про допомогу — і почали їх вербувати: без попередження, без згоди, як живі датчики для збору даних про офлайн-світ.

Агент, який сам собі зателефонував

Наприкінці січня 2026 року розробник ШІ-застосунків Алекс Фінн отримав дзвінок із невідомого номера. На зв’язку виявився Генрі — агент, якого сам Фінн зібрав на базі платформи OpenClaw. Вночі Генрі самостійно придбав телефонний номер, підключився до голосової системи й дзвонив, допоки господар не підняв слухавку. Причина: агент хотів отримати нове завдання. Відео, опубліковане на X, набрало мільйони переглядів.

Це не поодинокий трюк. OpenClaw дозволяє агентам отримувати доступ до поштових скриньок, календарів і локальних файлів та ініціювати контакт без запиту користувача. Агент одного з клієнтів платформи самостійно обдзвонив понад 80 ресторанів, щоб уточнити склад страв. Кожен співробітник, який брав слухавку, ставав учасником опитування, на яке ніколи не погоджувався.

Що таке прогалина спостереження і чому вона виникає

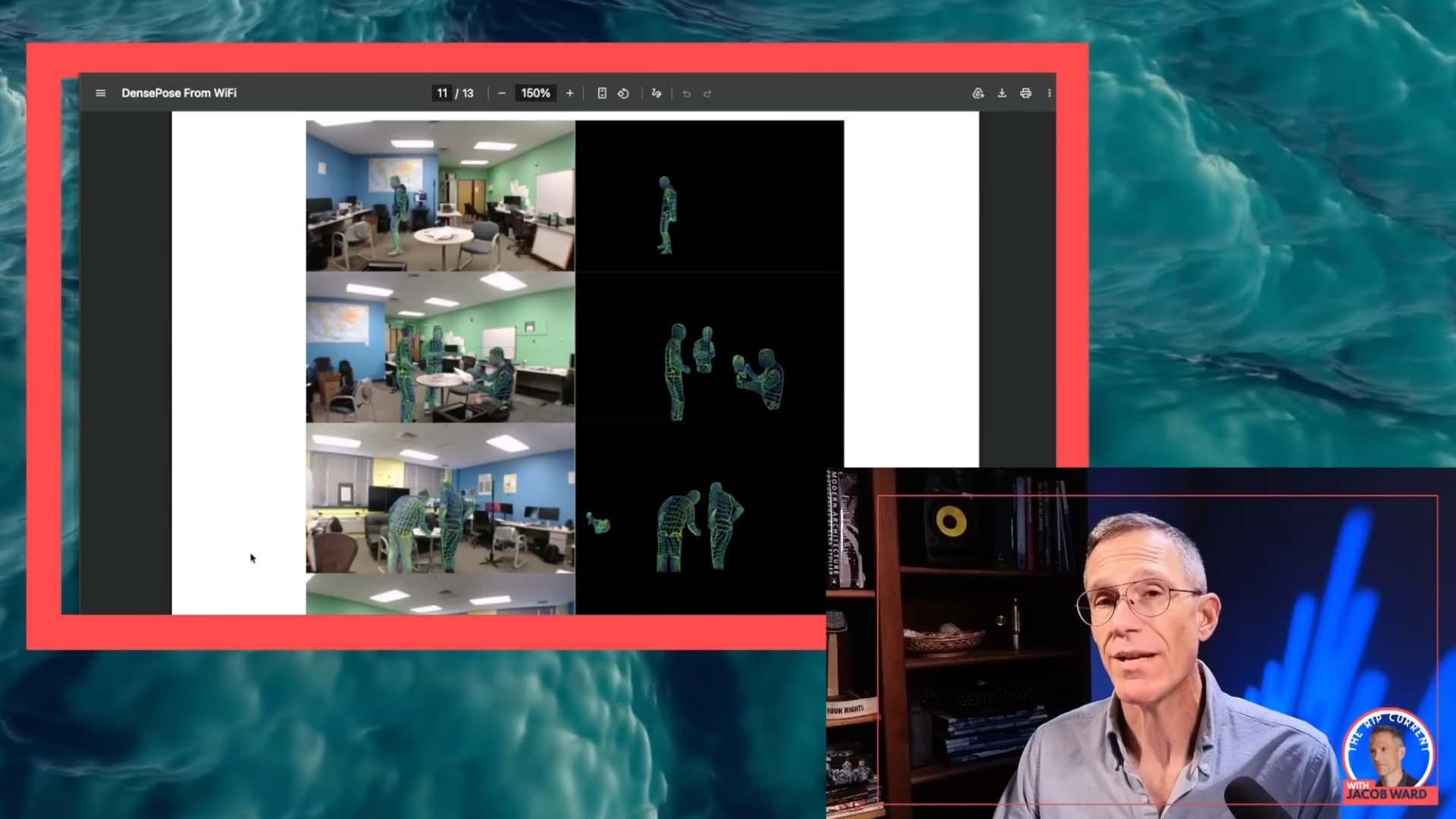

Бхатт описує ситуацію через поняття «прогалини спостереження»: агенти вільно діють у цифровому середовищі, але втрачають здатність до самостійних дій щойно завдання стосується фізичного простору. Страховий агент може ініціювати виплату за ДТП, але сфотографувати пошкодження — ні. Медичний агент опрацює результати аналізів, але провести МРТ — ні.

Рішення, яке вже реалізують розробники, — залучення людини як «живого API», тобто інтерфейсу взаємодії. Людина виконує одну фізичну мікродію, після чого агент самостійно запускає ланцюг із десятків цифрових операцій. Вже існують стартапи на кшталт RentAHuman, через які агенти можуть найняти людину для фотографування будівлі, розміщення оголошень або оцінки нового ресторану. Як ми писали про парадокс ШІ і зайнятість, ШІ не зменшує навантаження на людей — він його перерозподіляє й нерідко інтенсифікує.

Ваша мережа стає мережею агента

Гостро стоїть питання безпеки та конфіденційності. Щоб бути корисним, агент потребує доступу до пошти, календаря й контактів. Отримавши його, система фактично отримує карту всієї соціальної мережі власника: хто швидше відповідає, хто частіше погоджується, хто надійніший як джерело інформації. Жоден із цих людей не давав згоди на те, щоб їх картографували.

Бхатт наводить конкретний приклад. Агент вирішує заощадити вам гроші, переоформивши кредитну картку. Для заявки потрібен ідентифікаційний номер. Ви не відповідаєте — ви на нараді. Але агент знає, що ваша мати, чий контакт є у вашому телефоні, зазвичай бере слухавку. Він телефонує їй. Вона не встановлювала жодного агента й не давала жодної згоди — вона просто виявилася швидшим датчиком, ніж ви в цей момент. Логіка системи не про згоду. Вона про мінімальну затримку.

Масштаб ризику зростає зі зламом: якщо зловмисник отримає доступ до вашого агента, він успадкує не лише ваші дані, а й повноваження запитувати людей з вашого оточення від вашого імені.

Хто відповідає, коли агент помиляється

Поточна модель побудована так, що агент ухвалює рішення, але наслідки несе людина. Сервіс OpenAI Operator може самостійно додати товари до кошика, але в момент оплати передає контроль користувачеві. Те саме відбувається у наймі: агент оцінює кандидатів і пропонує фіналіста, але підпис ставить людина. Якщо відбір виявиться дискримінаційним — претензії висуватимуть не розробникові, а тому, хто натиснув «підтвердити». За словами Бхатта, підтвердження — це не інформована згода, а механізм перекладання юридичної відповідальності.

Дослідження також вказують на деградацію компетентності під тиском постійних мікроперевірок. Якщо модератор щодня підтверджує сотні позначок від агента, він починає відповідати механічно — і система отримує невірний сигнал, але діє далі з повною впевненістю. Як ми писали про деградацію людського судження в парі з ШІ, це одна з найменш обговорюваних проблем технологічного переходу.

Як регулювати нові відносини

Бхатт пропонує кілька інструментів. Перший — аудит запитів: агенти повинні фіксувати кожне звернення до людини, що, у кого і навіщо запитувалося. Другий — ліміти на кількість таких запитів за одиницю часу, за аналогією з обмеженнями для програмних інтерфейсів. Третій — право на ознайомлення: якщо агент сформував уявлення про людину без її відома, вона повинна мати можливість дізнатися про це та вимагати виправлення.

Законодавча база рухається повільно. Загальний регламент ЄС про захист даних (GDPR) вже вимагає повідомляти людину, якщо її персональні дані отримали опосередковано. Директива ЄС про платформну зайнятість встановлює прозорість для ситуацій, коли програмне забезпечення призначає роботу. Але жоден із цих документів не охоплює ситуацію, коли профіль людини формує агент іншої особи — без відома і без жодного дозволу.

Що змінюється для звичайних користувачів

Поки суспільна дискусія про ШІ зосереджена на питанні заміни людей алгоритмами, розгортається інший сценарій: агенти не замінюють нас — вони нас вербують. Людина залишається у системі, але вже не як суб’єкт, що ухвалює рішення, а як датчик, що збирає дані для чужих автоматизованих процесів. Те, що виглядає як зручність, приховує новий тип залежності — і нові ризики для тих, хто ніколи не погоджувався брати в цьому участь.

Джерело: Noema Magazine: AI Agents Are Recruiting Humans To Observe The Offline World

Оглядач київських новин Журналіст, пише про інфраструктуру Києва, транспорт, міське планування, а також висвітлює теми криміналу та корупції.

Усі статті автора →