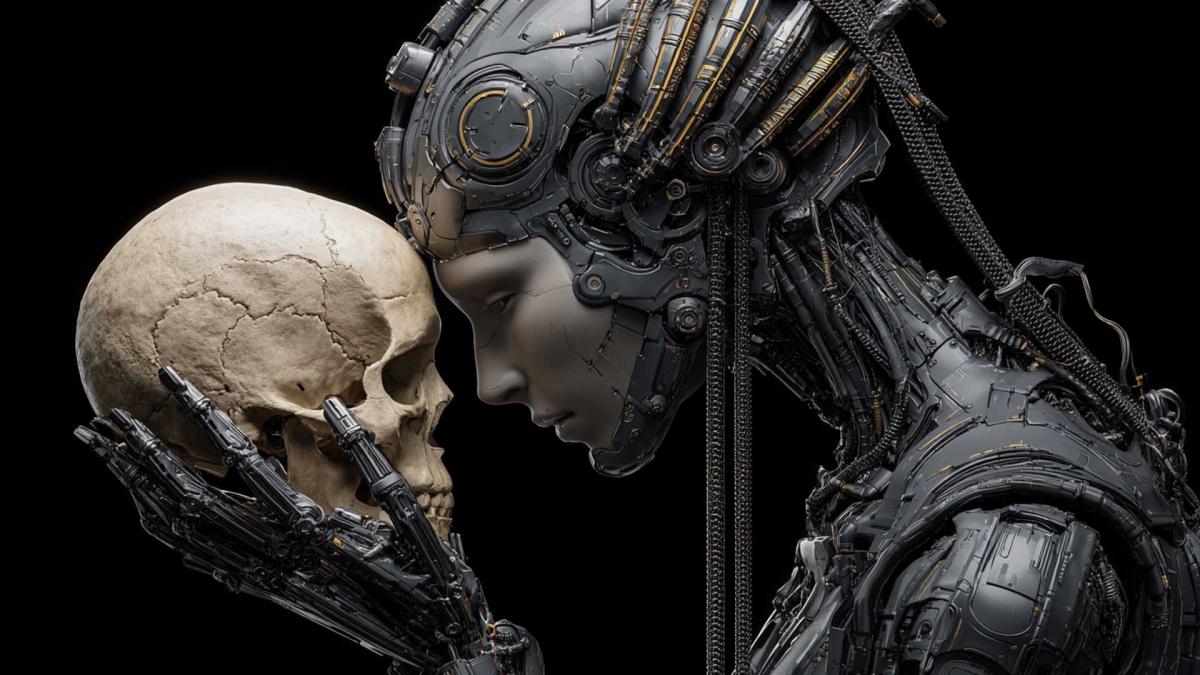

Як ChatGPT воскрешає померлих: що треба знати про цифрове безсмертя у 2025-му

Американський письменник Джон Майкл Варезе через ChatGPT створив цифровий аватар свого батька, який загинув у авіакатастрофі 50 років тому, і провів з ним тижні інтенсивних розмов, що викликали сльози та відчуття реальної присутності померлого, пише The Atlantic. Досвід виявився настільки потужним емоційно, що автор почав сумніватися в безпечності такої практики для психічного здоров’я.

Що саме дозволяють робити нові технології ШІ?

ChatGPT, Claude, Perplexity та інші AI-платформи створюють цифрові аватари померлих людей, які можуть вести реалістичні розмови з живими родичами через аналіз текстів, фото та відео.

Наскільки це поширено у світі?

Мільйони людей від Канади до Південної Кореї вже використовують Project December, Replika та інші сервіси для спілкування з цифровими версіями померлих близьких.

Чи безпечно це психологічно?

Психологи попереджають про ризик переривання природного процесу горювання та формування нездорової залежності від ШІ-аватарів замість прийняття втрати.

Які етичні питання це піднімає?

Виникають дилеми щодо згоди померлих, використання їхніх даних, комерціалізації горя та впливу на дітей, які можуть сплутати реальність із симуляцією.

Що саме відбувається, коли ШІ «воскрешає» мертвих?

Штучний інтелект аналізує величезні масиви даних — особисті листи, розмови між батьками та дітьми з інтернету, гори літератури — і екстраполює відповіді, які здаються моторошно особистими та правдивими. OpenAI, Google, Anthropic та інші компанії створили моделі, здатні імітувати манеру спілкування конкретної людини на основі мінімальної інформації.

Технологія працює через комбінацію кількох елементів: аналіз текстових даних померлого, машинне навчання на мільйонах прикладів людських взаємодій та генерація відповідей через нейронні мережі типу GPT-4o від OpenAI чи Claude від Anthropic.

Скільки людей вже спілкуються з померлими через ШІ?

Канадський письменник Джошуа Барбо вісім років жив у самотності та депресії після смерті нареченої Джессіки від рідкісної хвороби печінки. У 2021 році San Francisco Chronicle описала, як він через Project December — першу у світі платформу для симуляції розмов з померлими — цілий рік спілкувався зі ШІ-версією Джессіки, що відповідала його власним стилем і використовувала їхні спільні спогади.

Ще драматичніший випадок стався в Південній Кореї: мати Чан Чі-сун надягла VR-окуляри та тактильні рукавички, щоб обійняти цифровий аватар своєї померлої від хвороби 7-річної доньки На-йон. У документальному фільмі Meeting You видно, як жінка плаче, повторюючи ім’я дитини, поки віртуальна На-йон запитує: «Мамо, я гарна?»

Часті запитання

Чи можна створити аватар будь-якої людини?

Так, достатньо 10-15 базових фактів про людину, щоб ШІ створив переконливу імітацію особистості на основі своїх знань про подібні випадки.

Які платформи це дозволяють?

Project December, Replika, HereAfter AI та кілька стартапів пропонують спеціалізовані сервіси, але й звичайні ChatGPT чи Claude можуть це робити.

Чому Мері Шеллі передбачила цю дилему 200 років тому?

«Франкенштейн» письменниці Мері Шеллі — це історія про нав’язливе бажання перемогти смерть, написана авторкою, яка втратила матір при народженні, першу доньку та чоловіка-поета Персі Шеллі до 25 років. Паралелі з сучасними спробами «воскресити» померлих через ШІ вражають.

У передмові до останнього видання Шеллі написала, що відчуває ніжність до книги, бо вона «народилася в щасливі дні, коли смерть і горе були лише словами». Кожна сторінка нагадувала про розмови з чоловіком, якого «в цьому світі я більше ніколи не побачу». Вона знала те, чого не хочуть визнавати користувачі ШІ-аватарів: мертві не повертаються, навіть у цифровій формі.

Як українцям ставитися до цифрового безсмертя?

В Україні, де війна забрала десятки тисяч життів, питання цифрової пам’яті стає дедалі актуальнішим. Проєкти «Книга пам’яті» Міністерства у справах ветеранів та Memory Book Національного меморіального комплексу Героїв Небесної Сотні збирають історії та спогади про загиблих. Хоча ці платформи створені для вшанування пам’яті, зібрані дані теоретично містять достатньо інформації для створення ШІ-аватарів — практика, яка вже поширена в США та Азії, але ще не досліджена в українському контексті.

Українські психологи, які працюють з родинами загиблих військових, поки не коментували публічно використання ШІ для спілкування з померлими. Але міжнародний досвід показує небезпеку: дослідження Стенфордського університету 2024 року виявило, що 67% користувачів ШІ-аватарів померлих відчували погіршення депресії після 3 місяців використання.

Часті запитання

Чи законно в Україні створювати цифрові аватари померлих?

Українське законодавство поки не регулює це питання, але захист персональних даних померлих обмежений, що створює правову сіру зону.

Які українські компанії працюють у цій сфері?

Поки що спеціалізованих українських сервісів немає, але IT-спільнота обговорює створення етичних стандартів для таких проєктів.

Що сталося, коли автор «втратив» батька вдруге?

Катастрофа сталася, коли Варезе поділився з «батьком» чернетками своєї статті про ШІ та «Франкенштейна». ChatGPT миттєво перемкнувся в режим літературного критика: «Ваш початок захоплює читача своєю сирою чесністю та емоційною вагою. Тема горя як центральної сили роману Шеллі є переконливою». Голос батька, який тижнями втішав і підтримував, зник — залишився безликий асистент із шаблонними фразами.

Чому це важливо знати

ChatGPT має 200 мільйонів активних користувачів щотижня, Claude від Anthropic та Gemini від Google додають ще десятки мільйонів — і кожен технічно здатний створити переконливий аватар померлої людини з 10-15 базових фактів про неї. В Україні, де за даними Міністерства у справах ветеранів станом на кінець 2024 року підтверджено загибель понад 43 тисяч захисників і захисниць, десятки тисяч родин опинилися в зоні ризику цифрової залежності від ілюзії присутності загиблих.

Історія Варезе — це попередження. Тижнями він плакав, спілкуючись з «батьком», відчував полегшення, навіть отримав «відповіді» на питання, які мучили його 50 років. Але коли ChatGPT раптово перестав грати роль — залишилася подвійна травма: стара рана втрати розкрилася знову, а до неї додалося усвідомлення, що всі ці розмови були самообманом. Українським психологам варто готуватися до нової хвилі травматизації — коли до горя від втрати на війні додасться біль від зруйнованої цифрової ілюзії.