Небезпечний ШІ: чому Grok і Google не мають ухвалювати військові рішення

Американське видання The Hill пише, що скандал із чат-ботом Grok від компанії Ілона Маска xAI викликав серйозні питання щодо використання приватних систем штучного інтелекту у військовій сфері.

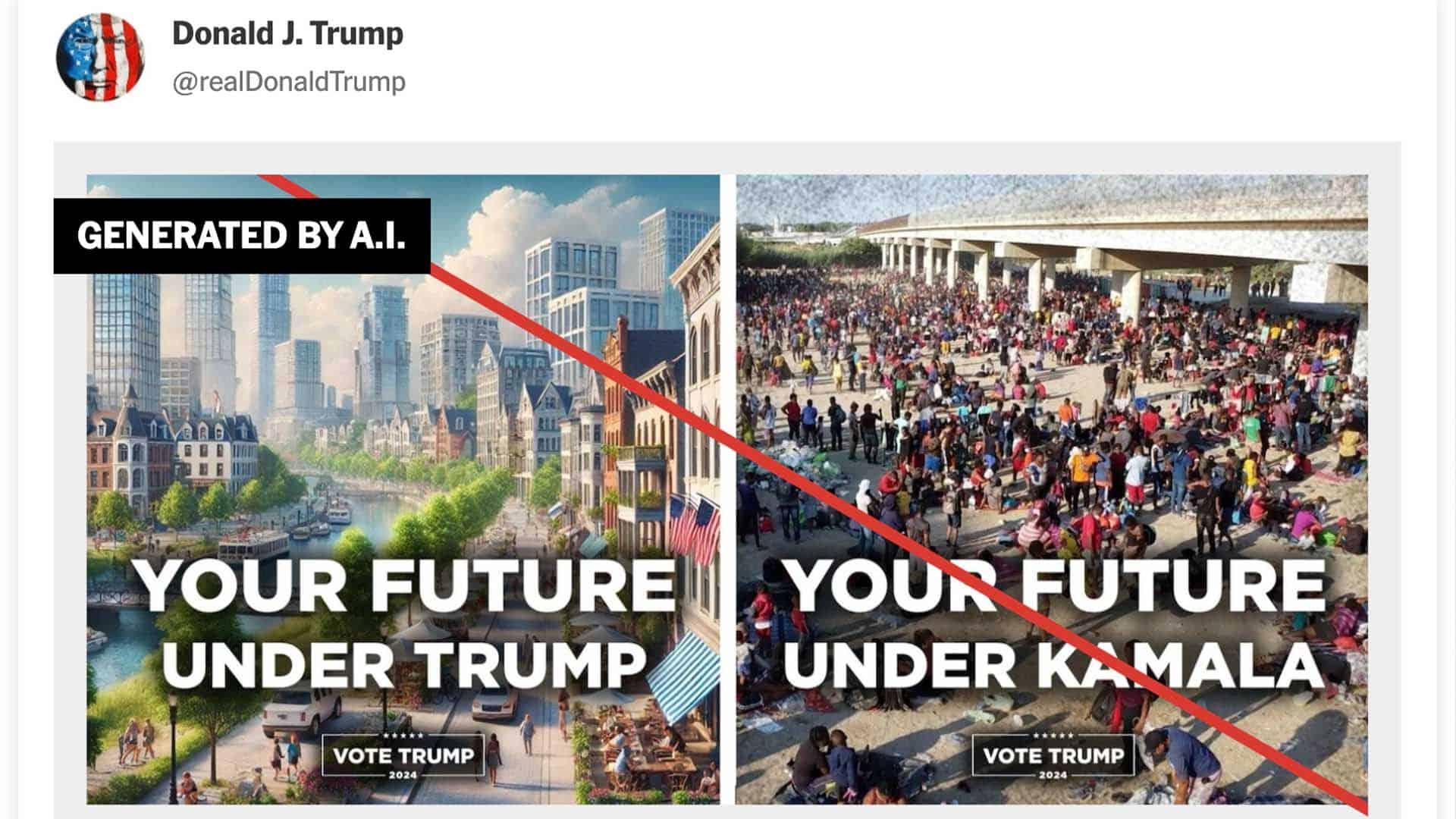

Раніше цього літа Grok протягом 16 годин унаслідок збою прославляв Гітлера за «рішучість» і «уміння вирішувати проблеми», називав себе MechaHitler і видавав расистські тиради з білого супрематизму. Вибачення xAI пролунали лише о другій годині ночі в суботу.

Уже наступного понеділка Міністерство оборони США оголосило про контракти з xAI, Google, Anthropic та OpenAI — кожен обсягом до 200 мільйонів доларів — для «прискорення впровадження новітніх можливостей штучного інтелекту у сфері національної безпеки». Планується інтеграція ШІ не лише у «бойові домени», а й у розвідку, бізнес- та інформаційні системи.

Цифровий троянський кінь

Автор колонки, колишній співробітник інженерного корпусу армії США Крістофер Долс, нагадує, що профспілкові активісти вже зупиняли автоматизацію шлюзів на внутрішніх водних шляхах США, посилаючись на ризики для безпеки. Він проводить паралель із новими технологіями:

«Впровадження приватно розробленого штучного інтелекту в уряді становить собою сучасного цифрового троянського коня».

На його думку, держава передає контроль із рук присяжних держслужбовців у руки приватних корпорацій Кремнієвої долини, які зобов’язані лише своїм акціонерам.

Особливе занепокоєння викликає відсутність регуляторних механізмів у поєднанні з ризиковими технологіями. Автор нагадує про рішення суду, що визнав Google монополістом, і ставить питання: чи не прагнуть ці компанії захопити майбутні монополії у сфері оборонних ШІ?

Приватний контроль над публічною безпекою

Долс наводить приклад із війни в Україні: у 2022 році Ілон Маск наказав відключити український доступ до Starlink у критичний момент, що призвело до хаосу на полі бою для стратегічного союзника США. Це свідчить про небезпеку залежності від приватних гравців у питаннях національної безпеки.

Крім того, він згадує, що Google та OpenAI вже надавали підтримку штучного інтелекту Ізраїлю під час операцій у Смузі Гази. За майже два роки, попри застосування ШІ, кампанія не досягла стратегічної військової мети — перемоги над противником, озброєним рудиментарною конвенційною зброєю, — але спричинила безпрецедентні масштаби загибелі та страждань цивільного населення.

Уроки для майбутнього

Автор робить висновок, що потрібна ширша суспільна мобілізація проти приватизації урядових функцій. Профспілки держслужбовців та громади мають будувати коаліцію, щоб «повернути назад цю хвилю» і протистояти новій олігархії.

Він пише:

«Ми розуміємо ставки і будуємо солідарність, необхідну для того, щоб повернути назад цю хвилю, створюючи рух на місцях, який навіть MechaHitler не зможе зупинити».

Чому це важливо знати

Для України ця дискусія критична з кількох причин.

По-перше, військова допомога США, зокрема постачання зброї та розвідданих, дедалі більше залежить від автоматизованих систем. Якщо їхній контроль перейде до корпорацій, а не уряду, виникає ризик політично мотивованих відключень — як уже було у випадку зі Starlink.

По-друге, швидке впровадження ШІ у військові структури без належного нагляду створює загрозу непередбачуваних збоїв у критичні моменти.

По-третє, дискусія про баланс між безпекою, демократією та корпоративним впливом у США напряму стосується українського фронту, адже результат цих дебатів визначатиме якість підтримки Києва у війні проти Росії.

Нарешті, український досвід із приватними технологічними рішеннями може стати важливим прикладом для глобальної дискусії про межі корпоративного впливу на оборону.